Návod na vytvoření LORA modelu pro Stable Diffusion

LORA (Low-Rank Adaptation) umožňuje snadné přizpůsobení modelů Stable Diffusion bez nutnosti jejich kompletního přetrénování. Tento postup šetří čas, paměť a poskytuje flexibilitu při úpravě AI modelů.

Klíčové body:

- Výhody LORA: Menší velikost modelu (2–500 MB), rychlejší trénink a nižší nároky na hardware.

- Požadavky na hardware: Doporučeno GPU s 24 GB VRAM, 64 GB RAM a 100 GB volného úložiště.

- Příprava datasetu: Obrázky s rozlišením alespoň 512×512 px, konzistentní poměr stran a kvalitní úprava.

- Tréninkové parametry: Použijte rank 4–32, learning rate 3e-5 až 8e-5 a 2–3 epochy.

- Použití modelu: Aktivujte model v promptu Stable Diffusion pomocí syntaxe

[lora:nazev_modelu:váha].

Rychlé srovnání: LORA vs. Tradiční modely

| Vlastnost | Tradiční model | LORA model |

|---|---|---|

| Velikost | 2–7 GB | 2–500 MB |

| Nároky na GPU | Vysoké | Nízké |

| Rychlost tréninku | Pomalá | Rychlá |

LORA modely výrazně zjednodušují práci s AI a umožňují rychlé přizpůsobení i na méně výkonném hardwaru.

Potřebné nástroje a nastavení

Požadavky na počítač

Pro trénink LORA modelu doporučujeme následující minimální a doporučené specifikace:

| Komponenta | Minimální požadavky | Doporučené požadavky |

|---|---|---|

| GPU paměť | 12 GB VRAM | 24 GB VRAM |

| Operační paměť | 32 GB RAM | 64 GB RAM |

| Úložiště | 50 GB volného místa | 100 GB volného místa |

| GPU | NVIDIA řady RTX 20xx | NVIDIA RTX 3090 |

Instalace softwaru

- Python: Stáhněte nejnovější verzi z python.org.

- PyTorch: Nezbytný framework pro strojové učení.

- Kohya SS: Nástroj určený pro trénování modelů.

- AUTOMATIC1111: Webové rozhraní pro Stable Diffusion.

Nastavení Python prostředí

Nejprve vytvořte virtuální prostředí a aktivujte ho:

python -m venv lora-env

lora-env\Scripts\activate # Pro Windows

Poté aktualizujte pip a nainstalujte potřebné knihovny:

pip install --upgrade pip

pip install git+https://github.com/huggingface/diffusers

pip install accelerate wandb

pip install -r requirements.txt

Ověřte funkčnost GPU akcelerace příkazem:

accelerate config default

Doporučení pro dataset

- Používejte obrázky s minimálním rozlišením 512×512 pixelů.

- Zajistěte konzistentní poměr stran u všech tréninkových obrázků.

- Dataset by měl být vyčištěný a bez chyb.

Tento postup vytvoří pevný základ pro další kroky při tréninku. Následně se zaměřte na přípravu dat.

Sběr a zpracování dat

Kvalitní data jsou nezbytná pro efektivní trénink modelu LORA.

Výběr tréninkových obrázků

Výběr správných obrázků hraje zásadní roli. Dataset by měl obsahovat 10 až 20 obrázků, minimální počet jsou 3.

Požadavky na obrázky:

- Rozlišení alespoň 1024×1024 px

- Podporované formáty: PNG, JPG

- Konzistentní poměr stran

- Dobrá ostrost

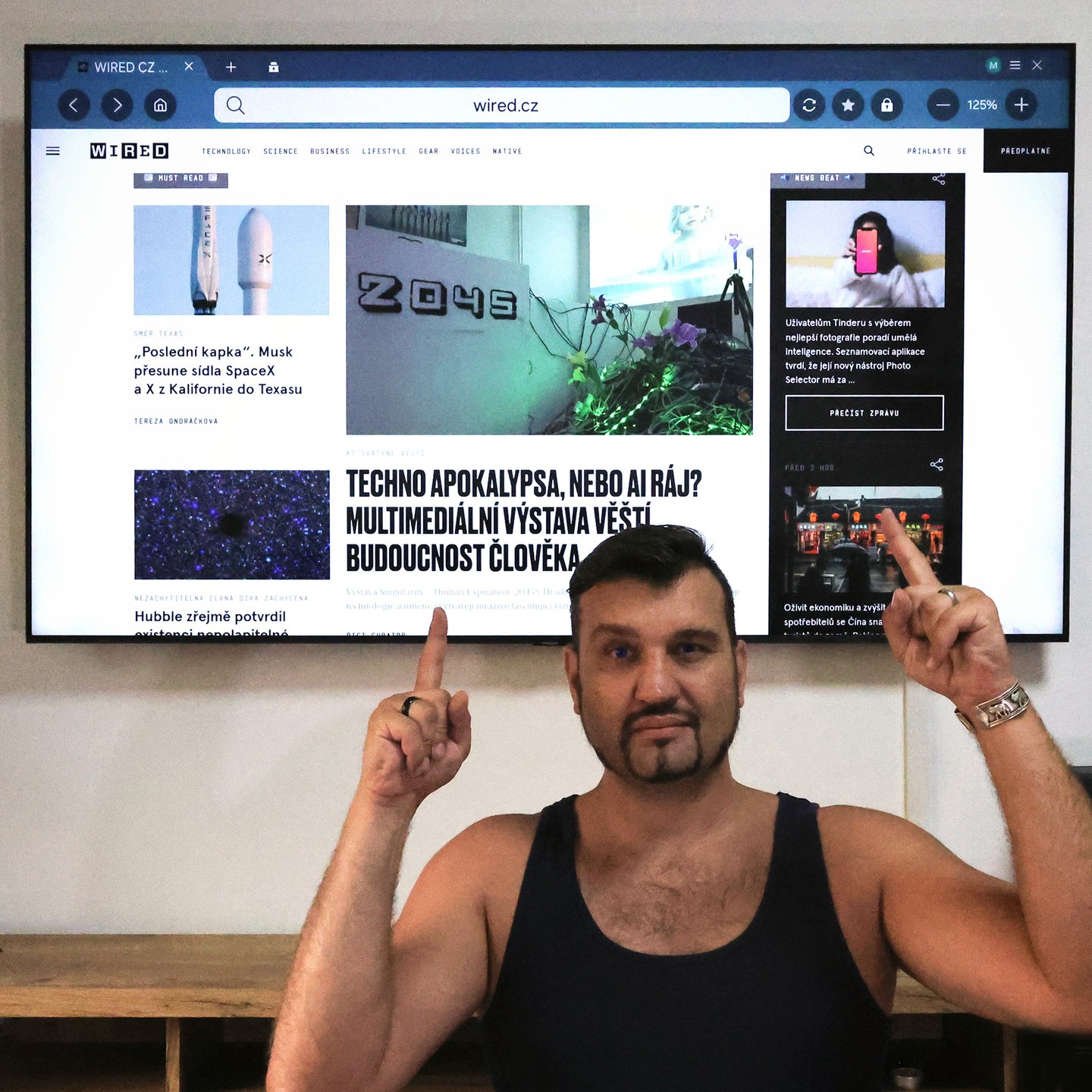

Pro modely zaměřené na postavy vybírejte fotografie, kde je postava jasně viditelná:

- Samostatná, bez dalších osob

- S různými výrazy (např. úsměv, vážný výraz)

- V podobném věku

- Bez výrazných doplňků jako sluneční brýle nebo silné líčení

Jakmile máte obrázky vybrané, přistupte k jejich úpravě, aby dataset měl jednotnou kvalitu.

Příprava obrázků

Před tréninkem je potřeba obrázky standardizovat:

- Ořízněte obrázky na jednotný formát, například 1:1.

- Zaměřte se na hlavu a část ramen.

- Zmenšete velikost na 768×768 pixelů.

2. Zlepšení kvality

Kvalitu obrázků lze zvýšit pomocí následujících nástrojů:

Po úpravě obrázky uspořádejte do strukturovaného systému.

Struktura souborů

Použijte tuto strukturu složek:

| Složka | Obsah | Formát |

|---|---|---|

training_images | Hlavní tréninkové obrázky | PNG |

validation | Obrázky pro validaci | PNG |

metadata | Popisky a metadata | TXT |

Pojmenování souborů:

- Dodržujte konzistentní schéma názvů (např.

model_01.png). - Vyhněte se formátům jako HEIC nebo WebP.

- Přidejte unikátní klíčové slovo pro snadnou identifikaci.

Nakonec všechny soubory zkomprimujte do ZIP archivu. Nastavte přesnost tréninku na hodnotu mezi 0,3 a 0,35.

sbb-itb-6f064b4

Průvodce tréninkem LORA modelu

Správné nastavení parametrů hraje důležitou roli při tréninku LORA modelu.

Nastavení tréninku

Pro dosažení dobrých výsledků je třeba věnovat pozornost následujícím parametrům:

| Parametr | Doporučená hodnota | Poznámka |

|---|---|---|

| Network Rank | 4–32 | Vyšší hodnoty obvykle nejsou nutné |

| Network Alpha | 1 nebo polovina ranku | Například při ranku 32 použijte hodnotu 16 |

| Learning Rate | 3e-5 až 8e-5 | Začněte s 3e-5 |

| Počet epoch | 2–3 | Obvykle postačí |

Tato nastavení pomohou modelu dosáhnout lepších výsledků při jeho aplikaci ve Stable Diffusion. Pro trénink doporučujeme použít model optimalizovaný pro režim bf16/fp16, díky čemuž se sníží nároky na VRAM. Při výběru základního modelu zvažte následující:

- Pro realistické výstupy: SD1.5, SD2.1 nebo SDXL

- Pro anime nebo kreslený styl: NAI (animefull-final-pruned) nebo SDXL

Spuštění tréninku

-

Příprava aktivačního tagu

Vytvořte specifický tag, který bude reprezentovat váš koncept. Tento tag musí být uveden jako první v popisech vašeho datasetu. -

Nastavení složky pro trénink

Složku s tréninkovými daty přejmenujte na formát '3_nazev', což automaticky nastaví opakování na 3. -

Monitorování průběhu

Použijte Tensorboard k sledování průběhu tréninku. Tento nástroj vám pomůže identifikovat přetrénování. Pokud ukládáte checkpointy po každé epoše, průběžně testujte výsledky z různých fází tréninku.

Řešení běžných problémů

Při tréninku se mohou objevit následující problémy:

Přetrénování a nedostatečné natrénování

- Přetrénovaný model produkuje přesycené obrazy s artefakty.

- Nedostatečně natrénovaný model nedokáže konzistentně reprodukovat požadovaný koncept.

Únik konceptů

Pro snížení rizika úniku konceptů:

- Používejte jedinečné aktivační tagy.

- Nastavte počet opakování datasetu tak, aby byla zachována rovnováha.

- Vyzkoušejte pivotní ladění pro vytvoření nového embeddingu.

Důležité: Při označování datasetu se zaměřte spíše na falešně negativní označení než na falešně pozitivní, protože ty mohou výrazně ovlivnit kvalitu modelu.

Generujte regularizační obrázky pomocí stejného modelu, VAE, rozlišení a sampleru (DDIM nebo DDPM), vždy s pevným seedem.

Po dokončení tréninku a vyřešení všech problémů přistupte k implementaci modelu ve Stable Diffusion. Následně můžete pokračovat s integrací vašeho LORA modelu do tohoto systému.

Použití LORA modelu ve Stable Diffusion

Jakmile máte svůj LORA model natrénovaný, můžete ho začít používat ve Stable Diffusion.

Načtení LORA modelu

Postup pro implementaci LORA modelu do Stable Diffusion:

- Stáhněte soubor LORA modelu a umístěte jej do složky

stable-diffusion-webui/models/Lora. - V promptu model aktivujte pomocí syntaxe

\[lora:nazev_modelu:váha\]. Váha určuje, jak moc model ovlivní výstup (např. 1 = plný vliv, 0,5 = poloviční vliv, 0 = deaktivace).

Jakmile je model načten, můžete přejít k testování jeho nastavení a výsledků.

Testování a úprava výsledků

Pro co nejlepší výsledky je klíčové správně nastavit parametry generování. Doporučené hodnoty:

| Parametr | Doporučená hodnota | Poznámka |

|---|---|---|

| Váha LORA | 0,35 – 1,0 | Začněte na 0,35 pro LCM-LoRA |

| CFG škála | 1,0 – 7,0 | Pro LCM-LoRA zkuste cca 1,0 |

| Počet kroků | 4 – 8 | Platí pro LCM-LoRA |

Používejte stejný základní checkpoint jako při tréninku a upravujte váhu podle tabulky, dokud nedosáhnete požadovaných výsledků. Sledujte, zda model věrně reprodukuje zamýšlený koncept.

Tipy pro lepší výsledky

Zde je několik užitečných tipů, jak doladit generování:

- Ujistěte se, že váš LORA model je kompatibilní s verzí Stable Diffusion, kterou používáte. Při kombinování více modelů postupujte opatrně.

- Pokud model není viditelný, zkuste obnovit seznam modelů v rozhraní Web UI.

- Experimentujte s aktivačními klíčovými slovy a váhou modelu, abyste dosáhli požadované kvality.

Pro stabilní výkon doporučujeme pravidelně aktualizovat Stable Diffusion Web UI na aktuální verzi a zachovat konzistentní nastavení mezi fází tréninku a generování obrázků.

Shrnutí

LORA (Low-Rank Adaptation) nabízí efektivní způsob, jak upravit Stable Diffusion bez nutnosti kompletního přetrénování modelu. Díky této technologii lze dosáhnout až 10× rychlejšího výkonu a 4× menší náročnosti na paměť.

Klíčové kroky

- Příprava dat: Zajistěte kvalitní dataset obrázků s jednotnými poměry stran, například 16:9 nebo 1:1.

- Nastavení trénování: Přizpůsobte tréninková nastavení podle doporučených parametrů.

- Testování a optimalizace: U LCM-LORA modelů používejte nízké hodnoty CFG (1–2) a omezte počet kroků vzorkování na 4.

Tyto kroky jsou základem pro dosažení kvalitních výsledků.

"LoRA modely jsou zásadními nástroji pro doplnění Flux AI checkpoint modelů. Umožňují Fluxu generovat obsah, na který nebyl trénován, například umělecké styly nebo konkrétní obličeje." – Stable Diffusion Art

Příklady LORA modelů

| Typ LORA | Příklad | Využití |

|---|---|---|

| Stylový | Crayon Style LoRA SDXL | Obrázky s efektem kreseb pastelkami |

| Konceptuální | Sticker Sheet LoRA | Tvorba designů samolepek |

| Objektový | Dog Example LoRA SDXL | Generování obrázků zaměřených na psy |

Pravidelná aktualizace softwaru a experimentování s parametry jsou klíčem k dosažení požadované kvality. Platformy jako Shakker AI navíc umožňují snadné trénování LORA modelů bez nutnosti lokální instalace.

Tento přehled vám poskytne základní informace pro úspěšnou aplikaci LORA modelů ve Stable Diffusion.